Handelen Meta droeg in Ethiopië bij aan geweld tegen Tigray-gemeenschap

Meta, het moederbedrijf van Facebook, heeft bijgedragen aan ernstige mensenrechtenschendingen tegen de Tigray-gemeenschap in Ethiopië tijdens het conflict in het noorden van het land. Dat staat in het vandaag gepubliceerde rapport van Amnesty International.

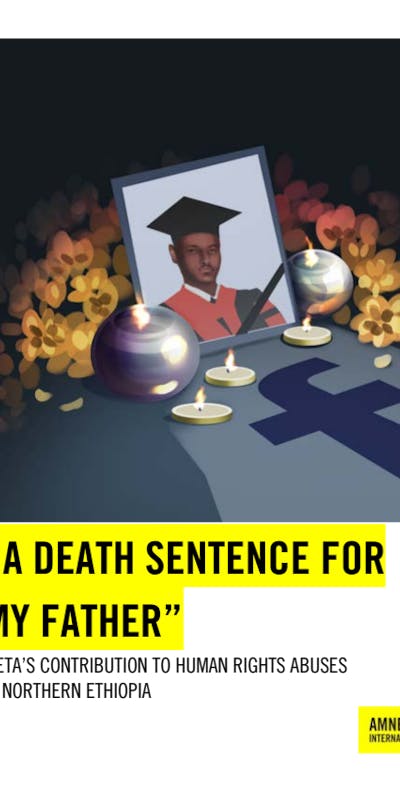

Het rapport ‘A death sentence for my father: Meta’s contribution to human rights abuses in northern Ethiopia’ laat zien hoe Meta opnieuw heeft gefaald bij het tegengaan van haatzaaien en het oproepen tot geweld. Die waren deze keer gericht tegen Tigreërs tijdens het gewapende conflict van november 2020 tot november 2022 in Noord-Ethiopië.

Amnesty International wees eerder op een soortgelijke bijdrage van Meta aan mensenrechtenschendingen tegen de Rohingya-minderheid in Myanmar. De mensenrechtenorganisatie waarschuwde toen al dat dit weer zou gebeuren als Meta het bedrijfsmodel en de algoritmes niet fundamenteel verandert.

Drie jaar na het onvoorstelbare falen in Myanmar heeft Meta opnieuw bijgedragen aan ernstige mensenrechtenschendingen. Zelfs voordat het conflict in Noord-Ethiopië uitbrak, waarschuwden maatschappelijke organisaties en mensenrechtenexperts er keer op keer voor dat Meta dreigde bij te dragen aan het geweld. Ze smeekten het bedrijf om zinvolle actie te ondernemen

Meta negeerde de waarschuwingen van lokale en internationale experts echter en deed niets, zelfs niet nadat het conflict was uitgebroken.

De bijdrage van Meta aan mensenrechtenschendingen

Het platform van Facebook wordt door veel Ethiopiërs beschouwd als een betrouwbare nieuwsbron. Het onderzoek van Amnesty International stelde vast dat de algoritmische systemen van Facebook de verspreiding van schadelijke retoriek gericht tegen de Tigray-gemeenschap versterkten.

Meta’s algoritmes zijn ontworpen om gebruikers zo betrokken mogelijk te maken. Het middel hierbij is het aanbieden van gerichte advertenties. Het gevolg: ze stimuleren opruiende, schadelijke en verdeeldheid zaaiende inhoud, die de neiging heeft om de meeste aandacht van gebruikers te trekken.

Tijdens het gewapende conflict wakkerde de verspreiding van haatzaaiende berichten en oproepen tot geweld mensenrechtenschendingen aan. Ondertussen slagen de contentmoderatie-systemen van het platform – waarmee foto’s, video’s en berichten worden gecontroleerd – er niet in om dergelijke schadelijke content te detecteren en er adequaat op te reageren.

Doodvonnis professor

Meta’s falen droeg uiteindelijk bij aan de moord op de Tigrese scheikundeprofessor Meareg Amare. Amare werd gedood door een groep mannen nadat er op 3 november 2021 berichten over hem op Facebook waren geplaatst. De Facebook-posts bevatten zijn naam, foto, werkplek en huisadres en er werd in beweerd dat hij een aanhanger was van het Tigrayan People’s Liberation Front (TPLF). Ook werd hij in de posts beschuldigd van het stelen van grote sommen geld. Deze beschuldigingen werden ontkend door zijn familie.

Zijn zoon Abrham Meareg weet zeker dat deze vijandige Facebook-posts hebben bijgedragen aan de dood van zijn vader. Hij vertelt aan Amnesty:

Ik wist dat het een doodvonnis voor mijn vader zou worden

Destijds woedde er een gewapende strijd in Noord-Ethiopië tussen TPLF, de Ethiopische Federale Strijdkrachten en andere gewapende groepen.

Meta op hoogte van risico’s

Uit interne Meta-documenten die Amnesty International heeft bestudeerd, blijkt dat Meta wist dat haar aanpak in Ethiopië tekortschoot en op de hoogte was van de risico’s. Ethiopië wordt zelfs door Meta beschouwd als een land met een hoog risico op geweld. In een intern Meta-document uit 2020 werd gewaarschuwd dat ‘de huidige strategieën voor risicobeperking niet voldoende zijn’ om de verspreiding van schadelijke inhoud op het Facebook-platform in Ethiopië te stoppen. Naast het versterken van schadelijke inhoud, zorgden Meta’s lange reactietijd op meldingen en de weigering om gemelde inhoud te verwijderen ervoor dat meerdere mensen die Amnesty International sprak het gevoel hadden dat het geen zin had om inhoud aan het bedrijf te melden.

Meta ontving zowel voor als tijdens het conflict meerdere waarschuwingen van maatschappelijke organisaties, mensenrechtenexperts en de eigen Facebook Oversight Board. Deze raadde Meta in 2021 aan een onafhankelijke beoordeling uit te voeren van de gevolgen voor de mensenrechten in Ethiopië. ‘De massale verspreiding van deze berichten zette aan tot geweld en discriminatie gericht tegen de Tigray-gemeenschap. Het gooide olie op het vuur van wat al een explosieve situatie was met grote etnische spanningen’, reageert Agnès Callamard.

Maatregelen dringend nodig

Gelila maakte deel uit van Meta’s ‘Trusted Partner’-programma en kon zo Meta snel waarschuwen voor schadelijke inhoud. Maar met die meldingen gebeurt te weinig. Volgens Gelila verslechtert het verzuim van Facebook om te reageren op waarschuwingen de mensenrechtensituatie in het land. ‘Als iemand die al lange tijd in Ethiopië is, kan ik zeggen dat Facebook gemeenschappen kwetsbaarder maakt voor onderlinge conflicten’, zei Gelila. ‘Meta reageert extreem traag en is niet gevoelig voor wat er gezegd wordt – ik denk dat ze normen hebben die heel ver afstaan van wat er ter plekke gebeurt.’

Meta moet dringend maatregelen nemen om de risico’s van het Facebook-platform afdoende te beperken in Ethiopië. Het land heeft op dit moment te maken met een nieuwe veiligheidscrisis in de Amhara-regio. Dit is essentieel, aangezien door de VN aangewezen onderzoekers hebben gewaarschuwd voor mogelijke toekomstige gruweldaden. Deze zorg werd later herhaald door de speciale VN-Adviseur voor de preventie van genocide, die waarschuwde voor een verhoogd risico op genocide en aanverwante gruweldaden in de regio’s Tigray, Amhara, Afar en Oromia.

Meta’s verantwoordelijkheid

Meta heeft de verantwoordelijkheid om een oplossing te bieden voor de mensenrechtenschendingen waaraan het bedrijf in Ethiopië heeft bijgedragen. Er zijn dringend brede hervormingen nodig, zodat het bedrijf niet opnieuw bijdraagt aan mensenrechtenschendingen in Ethiopië of in een ander land.

Dit omvat het inzetten van maatregelen tijdens noodgevallen. Het gaat om stappen die Meta in risicovolle en crisissituaties kan nemen om de kracht van algoritmische versterking te verminderen. Ook kan Meta daarmee zorgen voor gelijkheid en consistentie op het gebied van wetgeving wereldwijd over contentmoderatie, beleid en mensenrechtenteams.

Staten moeten hun mensenrechtenverplichtingen nakomen door wetgeving in te voeren en te handhaven om het bedrijfsmodel van Big Tech effectief aan banden te leggen. Hiervoor is een verbod van gerichte reclame op basis van indringende trackingpraktijken nodig.

Big Tech bedrijven hebben ook een verantwoordelijkheid om mensenrechten te respecteren, onafhankelijk van de verplichtingen van staten. Als ze dat niet doen, moeten ze verantwoordelijk worden gehouden voor de schendingen die ze hebben veroorzaakt of waar ze aan hebben bijgedragen.

Meta betwistte de bevindingen. Hun reactie wordt weergegeven in het rapport.

Lees hier meer.